我一直在关注这个教程中获得的图像的倾斜角度。 好像HoughLinesP正在努力寻找行时字符是一个有点散乱的目标图像。

这是我的输入图像:

这是HoughLinesP发现线路:

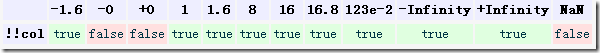

这不是真正得到大多数线,似乎很明显,我为什么。 这是因为我已经把我的minLineWidth为(size.width / 2.F)。 问题的关键是,由于几行已发现的事实证明,倾斜角度也是错误的。 (在这种情况下-3.15825,当它应该是接近0.5)

我试图蚕食我的输入文件以使角色更接近,在这种情况下,它似乎工作,但我不觉得这是一个类似于它的情况下最好的办法。

这是我的侵蚀输入图像:

这是HoughLinesP发现线路:

这一次,它已经找到-0.2185度的倾斜角度,这正是我所期待的,但在另一方面,它正在失去行之间的垂直空间,在我的愚见是不是一件好事。

是否有另一种预先处理这类形象,使houghLinesP得到分散人物更好的结果?

下面是我使用的源代码:

#include <iostream>

#include <opencv2/opencv.hpp>

using namespace std;

static cv::Scalar randomColor( cv::RNG& rng )

{

int icolor = (unsigned) rng;

return cv::Scalar( icolor&255, (icolor>>8)&255, (icolor>>16)&255 );

}

void rotate(cv::Mat& src, double angle, cv::Mat& dst)

{

int len = std::max(src.cols, src.rows);

cv::Point2f pt(len/2., len/2.);

cv::Mat r = cv::getRotationMatrix2D(pt, angle, 1.0);

cv::warpAffine(src, dst, r, cv::Size(len, len));

}

double compute_skew(cv::Mat& src)

{

// Random number generator

cv::RNG rng( 0xFFFFFFFF );

cv::Size size = src.size();

cv::bitwise_not(src, src);

std::vector<cv::Vec4i> lines;

cv::HoughLinesP(src, lines, 1, CV_PI/180, 100, size.width / 2.f, 20);

cv::Mat disp_lines(size, CV_8UC3, cv::Scalar(0, 0, 0));

double angle = 0.;

unsigned nb_lines = lines.size();

for (unsigned i = 0; i < nb_lines; ++i)

{

cv::line(disp_lines, cv::Point(lines[i][0], lines[i][1]),

cv::Point(lines[i][2], lines[i][3]), randomColor(rng));

angle += atan2((double)lines[i][3] - lines[i][1],

(double)lines[i][2] - lines[i][0]);

}

angle /= nb_lines; // mean angle, in radians.

std::cout << angle * 180 / CV_PI << std::endl;

cv::imshow("HoughLinesP", disp_lines);

cv::waitKey(0);

return angle * 180 / CV_PI;

}

int main()

{

// Load in grayscale.

cv::Mat img = cv::imread("IMG_TESTE.jpg", 0);

cv::Mat rotated;

double angle = compute_skew(img);

rotate(img, angle, rotated);

//Show image

cv::imshow("Rotated", rotated);

cv::waitKey(0);

}

干杯