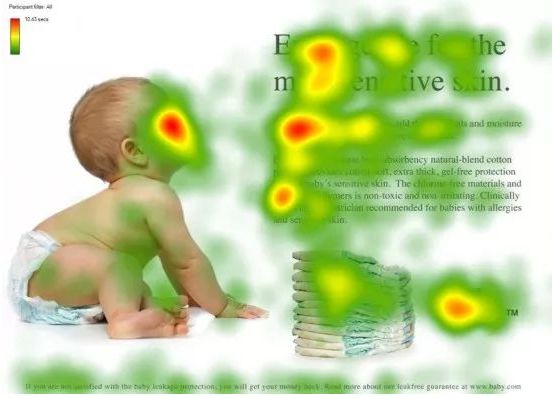

近日,网络上一张“课堂行为分析”的图片引发网民疑虑和警惕。据媒体报道,南京一高校在部分试点教室安装了人脸识别系统,用于日常考勤和课堂纪律管理。学生是否出勤、是否认真听讲、课堂上是否抬头低头、是否闭眼打瞌睡等行为,均能被智能识别。一些网民认为,它侵犯了学生的隐私权,是一种滥用技术的行为。对此,涉事高校回应称,该系统在校园只是“试点”“规划”,且教室属于公开场所,不存在“侵犯隐私”。教育部科学技术司相关人员在接受媒体采访时表示,校园推广人脸识别技术应谨慎,要加以限制和管理。开发该系统的旷视科技也发布声明称,该图片只是为技术场景化概念演示。

相关争议不断发酵,截至9月17日,仅微博话题#高校试水教室人脸识别#阅读量达1.1亿次,讨论量达2.5万条。舆论场除担忧此举有侵犯个人隐私之嫌外,数据安全、科技伦理及防范人工智能新技术带来的风险等,成为舆论焦点并引发深度探讨。

人工智能风险引起普遍担忧

人工智能一般是指“包括机器学习,基于收集、处理和适应来自现实世界的数据的算法。”近年来,我国人工智能产业呈现出蓬勃发展的良好态势,智能语音、智能网联汽车、智能视频图像身份识别等技术的发展及其所带来的日趋丰富的应用场景,正在深刻改变人们的生产生活方式,为经济社会发展注入了新动能。然而,人工智能带来的风险也引发舆论担忧。

7月13日,在第四届全球金融科技峰会上,央行科技司司长李伟警示AI人脸识别等新技术带来的新风险,强调要引导信息技术在金融领域合理的运用,不能滥用技术。他说,“前段时间在‘3·15’讲到‘隔空盗刷’的问题,支付场景没有表达出个人主观支付意愿。而人脸支付的时候,一刷脸钱就没了,其实更可怕。银行卡可能还揣在兜里,脸却是平常露在外面的,识别出来非常容易,现在有的技术在3公里之外识别你的人脸,没有表达客户主观意愿去刷脸是多么可怕的一件事情”。

8月30日,一款名为“ZAO”的人工智能换脸软件在社交媒体成为爆款。网民只需提供一张人脸照片,就可以将选定视频中的人物面部替换掉,从而生成新的视频片段。ZAO给网民带来新奇体验的同时,其存在的个人信息安全保护、肖像权、版权等安全隐患,也引发担忧。此外,ZAO所使用的换脸技术,曾在国外被用于情色视频制作。据报道,目前国内AI换脸黑产已经形成了完整的产业链,从下游成品情色视频、中游定制视频到上游软件及教程都有提供,有的卖家甚至提供全产业链产品和售后服务。英国《卫报》称此类软件为“对未来可怕的一瞥”,显示了对人工智能未来可能造成的伦理问题的担忧。

9月3日,工信部网络安全管理局对ZAO运营企业陌陌公司相关负责人进行问询约谈,要求其组织开展自查整改,强化网络数据和用户个人信息安全保护。对此,ZAO运营团队回应称,将严格按照法律法规和各主管部门的要求,以更加严格的标准,全面加强内容管理、完善各项管理机制,确保用户个人信息安全和数据安全。

人工智能带来的舆情风险

关于人工智能带来的技术风险一直是舆论热议话题。习近平总书记1月25日在中共中央政治局集体学习中指出:“要全面提升技术治网能力和水平,规范数据资源利用,防范大数据等新技术带来的风险。”

人工智能在给人类生活、社会经济带来新变化的同时,对于相关部门舆情处置与网络治理工作,也带来前所未有的挑战。

一是虚假新闻问题。

人工智能可以改变影像中物体的运动轨迹或者重塑人物形象,这让虚假新闻更难被识别,导致谣言的迅速扩散,甚至影响舆论走向。2018年4月,美国制片公司“猴爪(Monkeypaw Productions)”就曾利用名为“深度仿真”人工智能技术,制作了一段虚假视频。视频中的奥巴马对现任美国总统特朗普进行了严厉批评,几乎以假乱真。同年11月,美国白宫宣布吊销美国有线电视新闻网(CNN)记者吉姆·阿科斯塔的“通行证”,因为在总统新闻发布会上他攻击了一位女实习生。事后许多人质疑,白宫公布的现场视频是经过了人工智能处理,使得阿科斯塔的动作显得粗鲁和富于攻击性。可以预见,随着未来人工智能技术广泛运用,此类“谣言视频”将更多出现,助推舆情风波发酵升级。

二是“人工智能+网络平台”带来的复杂的信息管理难题。

当前媒介融合方兴未艾,人工智能成为提升生产力、传播力与影响力的重要手段。互联网商业平台与主流媒体上主要用于进行算法精准推送、个性化内容定制、机器人写稿与“中央厨房”建设等,未来应用场景将进一步扩展。同时,“人工智能+网络平台”也蕴含着诸多风险因素,值得研究和关注。比如人工智能算法主导的新闻生产与信息分发,带来了信息茧房效应与算法偏见等问题,冲击网络舆论生态。“机器人水军”的存在客观上也影响着舆论生态。

2018年3月,今日头条被网民举报避开北上广深等审查严格的大城市,借助技术优势,在监管松懈的二三线城市大量刊登违法广告。根据《经济半小时》记者实地调查发现,如举报所言,在南宁、成都等地,今日头条的广告推送中的确出现了大量的非法广告,引发舆论谴责。再如“人工智能+网络平台”并不能真正生产内容,而是内容“搬运工”。其可能带来的优质内容减少、版权问题以及内容质量良莠不齐,一直备受质疑。

三是舆论操控与数据滥用问题。

2018年3月,外媒报道脸书公司5000万用户信息被第三方公司“剑桥分析”用于大数据分析,根据用户的兴趣特点、行为动态精准投放广告和资讯内容,甚至被怀疑利用数据预测用户政治倾向,成为间接影响总统大选的力量。更有英美媒体报道称,这家公司曾经受雇于美国总统特朗普的竞选团队和推动英国“脱欧”的阵营。

再如,一些互联网公司采用大数据技术“杀熟”,都为人工智能时代规范数据运用、加强隐私保护敲响了警钟。

相关建议

在人工智能飞速发展的时代,其带来的风险与挑战值得重视。需要政府相关部门、业界和公众深入讨论,加强对潜在风险的研判和防范,让新技术更好地为我所用。有声音认为,人工智能技术治理关键是抓住三个核心关键问题:算法、数据和算力,要在相关方面来立法和监督。

第一,要高度重视人工智能给网络舆论带来的风险。

今年6月,因担心人工智能深度伪造会影响舆论生态,进而干扰2020年美国总统大选,美国众议院举行听证会。最终,美国众议院承诺审视“AI赋能的虚假内容引发的国家安全的威胁,要采取哪些措施才能发现并进行打击,公共部门、私营部门和整个社会要怎么做才能应对这种严峻的‘后真相’的未来。”因此,要充分评估人工智能给网络安全、国家安全等构成的威胁,加快人工智能前瞻性研究。

第二,确保算法公开透明、可监督。

当前,为规避人工智能带来的虚假新闻,一个行之有效的办法即要求公开商业平台机器算法的源代码,提升算法透明度。此外,人工智能技术目前被广泛运用于追踪和识别虚假新闻。

2018年10月,美国麻省理工大学公布了其人工智能系统。该系统利用现有的信息来评估分析信息发布者的可信度,并能将潜在的“误导性信息”筛选出来。今年4月,某互联网公司发布“AI谣言粉碎机”。据称,这款人工智能程序目前在特定场景中对网络谣言和假新闻的识别准确率已经达到81%,是应对虚假新闻的重要帮手。

因此,要进一步规避人工智能舆情应对的风险,也需要加强技术运用,把握技术“制空权”。

最后,要健全人工智能技术方面的法律法规以及行业自律制度,加强数据安全与隐私保护。

当前,包括人脸识别在内的人工智能的广泛应用已是大势所趋,更要安全地使用人工智能。比如网络数据收集,需要保障用户的数据安全,不得以牺牲用户隐私为代价,需要加强数据保护立法,不断强化人工智能应用中的用户隐私保护。

(作者:人民网舆情数据中心主任舆情分析师 廖灿亮)

编辑:王娟 | 责编:邱越