我有一个像下面的自定义分区:

import java.util.*;

import org.apache.hadoop.mapreduce.*;

public static class SignaturePartitioner extends Partitioner<Text,Text>

{

@Override

public int getPartition(Text key,Text value,int numReduceTasks)

{

return (key.toString().Split(' ')[0].hashCode() & Integer.MAX_VALUE) % numReduceTasks;

}

}

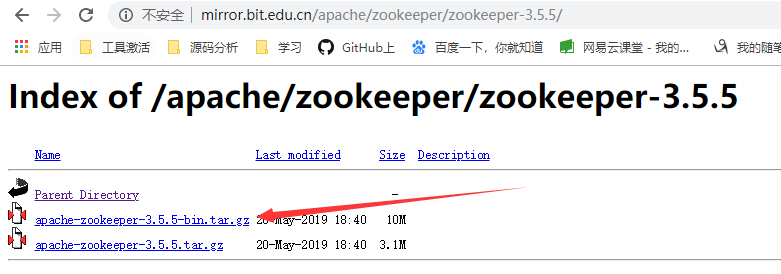

我设置了Hadoop的流参数如下图所示

-file SignaturePartitioner.java \

-partitioner SignaturePartitioner \

然后,我得到一个错误:找不到类。

你知道是什么问题?

最好的祝福,

我面临着同样的问题,但管理大量的研究后解决。

根本原因是流-2.6.0.jar使用mapred API,而不是MapReduce的API。 此外,实施分区程序接口,而不是扩展分区程序类。 以下为我工作:

import java.io.IOException;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapred.Partitioner;

import org.apache.hadoop.mapred.JobConf;`

public class Mypartitioner implements Partitioner<Text, Text> {`

public void configure(JobConf job) {}

public int getPartition(Text pkey, Text pvalue, int pnumparts)

{

if (pkey.toString().startsWith("a"))

return 0;

else return 1 ;

}

}

编译Mypartitioner,创建罐子,然后,

bin/hadoop jar share/hadoop/tools/lib/hadoop-streaming-2.6.0.jar

-libjars /home/sanjiv/hadoop-2.6.0/Mypartitioner.jar

-D mapreduce.job.reduces=2

-files /home/sanjiv/mymapper.sh,/home/sanjiv/myreducer.sh

-input indir -output outdir -mapper mymapper.sh

-reducer myreducer.sh -partitioner Mypartitioner

-file SignaturePartitioner.java -partitioner SignaturePartitioner

-file选项将提供由Hadoop框架所需的所有节点上的文件。 它需要指向类的名称,而不是Java文件名。